PUŁAPKI MYŚLENIA I ICH WPŁYW NA DECYZJE W MODELU FOGGA

W kilku poprzednich tekstach przedstawiłem niektóre błędy poznawcze (pułapki myślenia), m.in. podstawowy błąd atrybucji, myślenie tunelowe i moją autorską koncepcję sprzężonego błędu konfirmacji (Coupled Confirmation Bias). Pisałem o nich głównie w kontekście ich wpływu na dynamikę sporu, co obserwuję w mojej codziennej pracy. Teraz chcę pójść krok dalej i pokazać, jak te same mechanizmy wpływają na proces podejmowania decyzji w modelu Fogga.

Czym są błędy poznawcze?

Błędy poznawcze to inaczej błędy lub pułapki myślenia. Pojęcie to wprowadził do języka powszechnego Daniel Kahneman. Ten wybitny psycholog opublikował książkę „Pułapki myślenia. O myśleniu szybkim i wolnym„. Opisał w niej mechanizmy, które dotyczą nas wszystkich. Nie dlatego, że coś z nami nie tak. Te mechanizmy mają swoje istotne funkcje. Upraszczają wiele spraw. Pozwalają np. zachować energię, rozwiązać dany problem w sposób wystarczający na tyle, żeby zająć się następnym. Ale w złożonych relacjach społecznych sprawiają, że błędnie oceniamy rzeczywistość, tworzymy w głowie nieprawdziwe narracje i w efekcie podejmujemy błędne decyzje.

Jakie znamy błędy poznawcze?

Błędów poznawczych jest sporo, a pewnie wielu jeszcze nie odkryliśmy. Ja tu przedstawię krótko tylko z nich:

1. Błąd potwierdzenia (confirmation bias)

2. Podstawowy błąd atrybucji (Fundamental Attribution Error)

3. Błąd status quo (Status quo bias)

4. Efekt utopionych kosztów (sunk costs fallacy)

5. Sprzężony błąd konfirmacji (Coupled Confirmation Bias) – moja autorska koncepcja (i jej rozwinięcie), która jest wyłącznie hipotezą i wymaga rozwinięcia i empirycznego potwierdzenia.

6. Myślenie tunelowe (tunnel vision), które nie jest samo w sobie błędem poznawczym, ale mechanizmem systemowym.

Wpływ błędów poznawczych na podejmowanie decyzji choćby w kontekście zawierania porozumień jest przedmiotem pogłębionych badań naukowych. Część z nich jest uznana za hamujące, inne za wzmacniające. Ten podział jest przydatny do wyciągnięcia dalszych wniosków.

Poniżej przedstawię kolejno:

- tryb podejmowania decyzji w modelu Fogga i

- parametry podjętej decyzji.

Dopiero potem pokażę, jak wybrane błędy poznawcze mogą wpływać zarówno na to, czy w ogóle podejmiemy decyzję, jak i na jej treść.

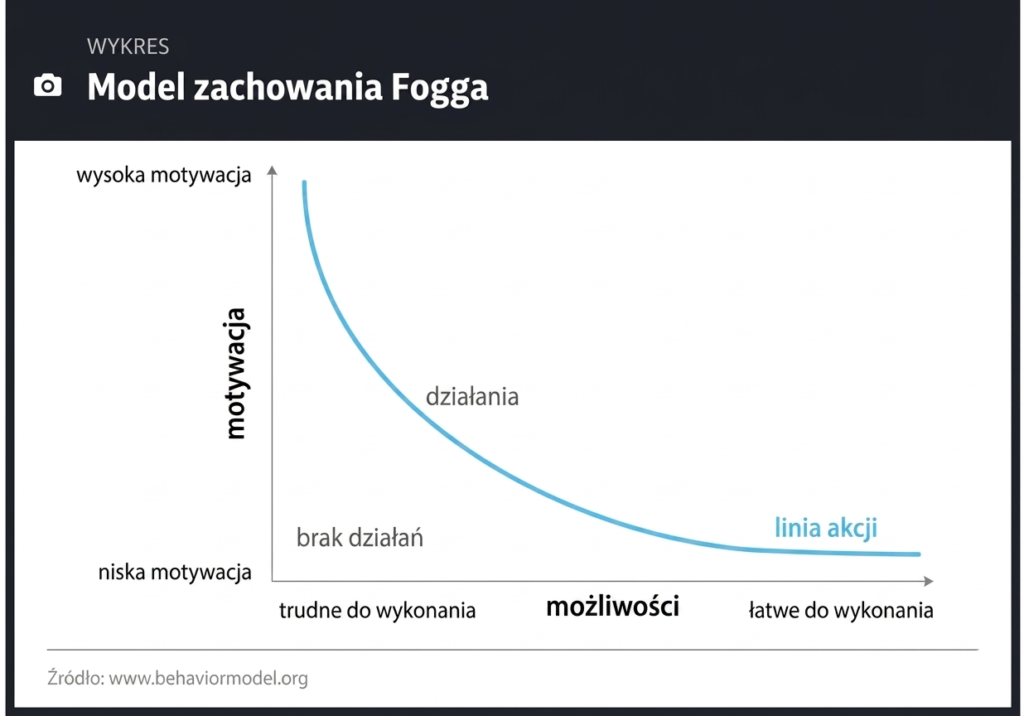

Podejmowanie decyzji w modelu Fogga. Triada decyzyjna

Model podejmowania decyzji Fogga jest prosty i elegancki. Obejmuje on triadę decyzyjną, na którą składają się: 1) motywacja; 2) wykonalność i 3) wyzwalacz. Jeśli chcecie dowiedzieć się o tym modelu więcej, więcej, odsyłam Was do artykułu, który napisałem o zastosowaniu modelu Fogga do analizy mechanizmu podejmowania decyzji i zakończeniu współpracy / wyjścia ze spółki. Tam napisałem więcej o motywacji jako stanie afektywnym o podłożu biologicznym, który ma dwa kierunki: pozytywy i negatywny. Teraz zobaczmy graficzne przedstawienie modelu decyzyjnego Fogga:

Zapamiętajmy z niego, że aby doszło do decyzji wszystkie 3 elementy 1) motywacja, 2) możliwość i 3) wyzwalacz muszą wystąpić: łącznie. Omówiłem to już szerzej w poprzednim tekście.

Teraz tylko postawię pytanie:

Czym jest „możliwość” w ujęciu Fogga?

Ja rozumiem możliwość jako właściwość, której cechy lepiej oddaje słowo „wykonalność”. Tego wątku nie rozwinąłem w poprzednim artykule, dlatego robię to teraz.

Wykonalność w modelu Fogga -w moim rozumieniu – jest wypadkową subiektywnie postrzeganych: 1) własnych możliwości i 2) trudności zadania.

Liczy się wyłącznie percepcja decydenta. Może on oczywiście źle ocenić sytuację wskutek błędu poznawczego lub błędu danych. Co ciekawe, błąd może prowadzić w efekcie do podjęcia korzystnej decyzji. Wyobraźmy sobie, że mam niepełne lub nieprawdziwe dane. Działając pod wypływem błędu logicznego lub błędu kognitywnego wyciągam z nich nieprawidłowe wnioski. Wnioski te byłyby ocenione jako prawidłowe, gdybym miał dostęp do pełnych lub prawdziwych danych, a nie działałbym pod wpływem błędu.

Można to podsumować jednym zdaniem: triada Fogga wpływa na podjecie decyzji, co nie jest tożsame ze sposobem jej realizacji. Sposób realizacji wcześniej podjętej decyzji jest opisywany przez parametry decyzji (o nich niżej).

Jakie są rodzaje decyzji?

Proponuję, by decyzjom analizowanym przez pryzmat sposobu ich wykonania przypisać 3 parametry. Decydują one o sposobie ich realizacji.

3 parametry decyzji to: wektor, dynamika i determinacja (zastanawiam się, czy nie lepiej nazwać ją pędem).

Pierwszym parametrem jest wektor. Jego punktem odniesienia niech będzie stan obecny. Jego wartość to 0 lub 1. Niech 0 oznacza tendencję do pozostania w obecnym układzie, a 1 jest dążeniem do zmiany.

Drugim parametrem jest dynamika. Wyróżnijmy 2 wartości dynamiki: (+) i (-), gdzie (+) oznacza, że decyzja skutkuje działaniem, a (-) biernością.

Trzecim parametrem jest determinacja (L) i (H), gdzie (L) – oznacza niską (ang low) determinację, a (H) oznacza wysoką (ang. high) determinację.

Wektor określa stosunek do stanu aktualnego i jego zmiany. Decyzja o obronie status quo lub jego zmianie może być realizowana – zależnie od okoliczności – przez bierność lub działanie (dynamika + lub –). Determinacja jest funkcją gotowości zaangażowania, przez które rozumiem wypadkową:

1) gotowości poniesienia kosztów (finansowych, wizerunkowych, organizacyjnych, energetycznych, a nawet biologicznych) oraz

2) tolerancji ryzyka.

Wektor, dynamika i determinacja stanowią uproszczony model heurystyczny, stworzony przeze mnie (a przynajmniej nie znam publikacji, które się tymi parametrami posługują – poza wyżej wspomnianymi biasami hamującymi i wzmacniającymi) na potrzeby tego opisu. Jego użyteczność wymaga z pewnością badań – jest to obecnie wyłącznie model hipotetyczny. Zaznaczam też, że ludzka psychika to nie matematyka, ale właśnie matematyka pozwala -paradoksalnie – zrozumieć psychikę lepie

Tabela 1: 3 parametry decyzji

| Parametr decyzji | Wartość parametru | Opis i znaczenie parametru |

|---|---|---|

| Wektor | 0 | Oznacza tendencję do utrzymania stanu obecnego. Decydent interpretuje sytuację jako taką, w której lepiej pozostać przy status quo. |

| 1 | Oznacza dążenie do zmiany stanu obecnego. Decydent uznaje, że obecny układ wymaga modyfikacji lub porzucenia. | |

| Dynamika | + | Decyzja realizowana przez działanie. Oznacza aktywne wykonanie czegoś, co ma doprowadzić do utrzymania lub zmiany stanu. |

| – | Decyzja realizowana przez bierność. Oznacza powstrzymanie się od działania jako sposób osiągnięcia celu (utrzymania lub zmiany). | |

| Determinacja | L | Niska determinacja. Oznacza ograniczoną gotowość poniesienia kosztów i niską tolerancję ryzyka. Decyzja jest słaba, łatwa do zmiany. |

| H | Wysoka determinacja. Oznacza dużą gotowość poniesienia kosztów (finansowych, emocjonalnych, organizacyjnych, biologicznych) i wysoką tolerancję ryzyka. Decyzja jest silna i stabilna. |

Użycie wyżej wymienionych 3 parametrów pozwala nam wyróżnić 8 rodzajów decyzji.

Tabela 2: 8 rodzajów decyzji

| Numer porządkowy rodzaju decyzji | Wektor | Dynamika | Determinacja | Opis decyzji | Przykład |

|---|---|---|---|---|---|

| 1 | 0 | – | L | Decyzja o utrzymaniu status quo przez bierność z niską determinacją | Decyduję, że jeszcze pośpię |

| 2 | 0 | – | H | Decyzja o utrzymaniu status quo przez brak działania z wysoką determinacją | Siedząc na drzewie decyduję, żeby się nie ruszać, żeby nie spaść |

| 3 | 0 | + | L | Decyzja o utrzymaniu status quo przez działanie z niską determinacją | Decyduję, że odganiam kota, który mnie budzi |

| 4 | 0 | + | H | Decyzja o utrzymaniu status quo przez działanie z wysoką determinacją | Bronię córkę przed napastnikiem |

| 5 | 1 | – | L | Decyzja o zmianie przez bierność z niską determinacją | Nie podlewam kwiatów, których nie lubię, żeby uschły |

| 6 | 1 | – | H | Decyzja o zmianie przez bierność z wysoką determinacją | Decyzja o zaniechaniu ratowania kogoś, gdy chcę, żeby się utopił |

| 7 | 1 | + | L | Decyzja o zmianie przez działanie z niską determinacją | Chcę obciąć kotu pazury |

| 8 | 1 | + | H | Decyzja o zmianie przez działanie z wysoką determinacją | Chcę uciec z więzienia |

Dodajmy, że:

- decyzje o wektorze 0 (zachowanie status quo) oraz

- decyzje o dynamice ujemnej (-) o osiągnięciu celu przez bierność

nie oznaczają w żadnym razie braku decyzji. To nie jest to samo. Decyduję się siedzieć cicho i nieruchomo, żeby ktoś mnie nie znalazł. Decyzja o tym nie jest tym samym, co zewnętrznie dostrzegana bierność spowodowana np. apatią lub ambiwalentnym stosunkiem do danego stanu.

Tak samo trzeba wspomnieć, że

- decyzja o zmianie (Wektor 1) nie może być utożsamiana z działaniem (+), a

- decyzja o bronieniu status quo (Wektor 0) nie może być utożsamiana z brakiem działania.

Stan wyjściowy (status quo) może być tak pożądany, że decydujemy się go aktywnie bronić (wektor 0, dynamika +). A więc nie chcąc zmiany podejmiemy działanie. Przykład: Jeśli chcę, aby tonący przeżył, będę go ratował. Nie chcąc dopuści do zmiany (życie -> śmierć) podejmę działanie.

Analogicznie, może się zdarzyć, że dążąc do zmiany zdecydujemy się na brak działania. Jeśli chcę, by topiący się umarł, wystarczy, że nie będę go ratował. Utonięcie oznacza zmianę jego stanu (życie -> śmierć) przy mojej bierności. Mamy tu więc wektor 1, dynamikę ujemną i determinację, której w tym przykładzie nie znamy, ale zakładamy, że musiałaby być bardzo wysoka.

Dla porządku jeszcze trzeba stwierdzić, że brak decyzji o zmianie nie jest tożsamy z decyzją o utrzymaniu status quo. Brak decyzji wynika z braku co najmniej jednego elementu triady decyzyjnej (patrz wyżej). Brak decyzji może zatem wynikać z braku motywacji, subiektywnie postrzegalnej niewykonalności lub braku wyzwalacza. Nie musi to oznaczać to, że dany bodziec jest dla nas obojętny. Może bowiem np. rodzić motywację, ale nie podejmiemy decyzji, bo zadanie wydaje nam się niewykonalne. W tej sytuacji obiektywny brak działania nie może być utożsamiany z biernością jako wyborem jednego z parametrów podjętej decyzji.

Przykład: Spotykając niedźwiedzia w górach mogę decydować o poddaniu się lub ratowaniu życia. Ale czy osiągnę to przez udawanie martwego, walkę czy ucieczkę – to już jest parametr decyzji. I w tym zakresie może być podjęta prawidłowo lub nieprawidłowo: mogę uciekać na drzewo, na które niedźwiedź wejdzie za mną, albo schować się w szczelinie w skałach, gdzie mnie nie dosięgnie. Nie zmienia to faktu, że postanowiłem trwać przy życiu (wektor 0) przez działanie w postaci ucieczki (dynamika +) lub bierność w postaci udawania martwego (dynamika -) przy wysokiej determinacji w każdym wypadku (H).

Jak wyżej zasygnalizowałem, należy odróżnić w tej sytuacji, czy leżę, bo wybrałem świadomie przeżyć przez udawanie martwego, od sytuacji, w której się położyłem i stwierdziłem, że i tak nie mam szans, a poza tym już od dawna nie chciało mi się żyć.

Jaki jest wzajemny stosunek błędów poznawczych, triady decyzyjnej i parametrów decyzji?

Wyżej zarysowałem trzy obszary: błędy poznawcze, triadę decyzją i parametry decyzji. Powstaje naturalnie pytanie, w jakich relacjach mogą one wobec siebie pozostawać.

Zacznijmy od zastrzeżenia, że nie ma tu żadnego determinizmu. Błędy poznawcze nie determinują podjęcia danej decyzji, ale zwiększają istotnie tendencję, „ciążą” w danym kierunku. Sygnalizuję też, że można pozostawać jednocześnie pod wypływem dwóch lub więcej błędów, mających rożne źródła, a których oddziaływanie krzyżuje się w danym momencie i każdy z nich „pcha” decydenta w innym (lub tym samy) kierunku.

Wpływ błędów poznawczych na triadę decyzyjną (podjęcie decyzji)

Jak wyżej zasygnalizowałem, błędy poznawcze mogą zadziałać na każdym etapie i poziomie podejmowania i realizacji decyzji. Może się okazać, że gdy zachodzi triada decyzja uaktywni się jeden błąd, a ustawiając parametry jej wykonania będziemy działać pod wpływem innego. Może być też tak, że dwa błędy zadziałają jednocześnie, a ich wzajemny stosunek będzie dodatni (będą działać w tym samym kierunku), lub cześciowo albo zupełnie przeciwstawny. Najczęściej jednak będziemy pozostawać pod wpływem jednego z nich.

Przyjmijmy, że błędy poznawcze mogą wpływać na:

- powstanie motywacji przez wpływ na ocenę bodźca rodzącego emocję, a w konsekwcgji na kierunek motywacji lub jej siłę;

- subiektywną ocenę wykonalności;

- podatność na wyzwalacz.

Przyjmijmy, że w odniesieniu do każdego z elementów triady decyzyjnej wpływ błędu poznawczego może być wzmacniający ⬆️ lub ⬇️ osłabiający.

W odniesieniu do motywacji błąd kognitywny może wpłynąć na samo jej istnienie (wywołać ją lub zgasić), a istniejącą motywację może wzmocnić lub osłabić.

W odniesieniu do percepcji wykonalności może wpłynąć na ocenę i poczucie wykonalności uczynić silniejszym lub słabszym (zarówno przez oddziaływanie na odczucie własnych możliwości, jak i subiektywnie postrzeganej trudności samego zadania).

Zakrzywienie oceny wywołane błędem poznawczym skutkuje więc tym, że można:

- ocenić zadanie jako wykonalne, gdy nie jest wykonalne;

- ocenić zadanie jako niewykonalne, gdy jest wykonalne.

a w konsekwencji:

- podjąć decyzję, gdy cel jest „pożądany”, ale obiektywnie nieosiągalny (brak wykonalności);

- nie podjąć decyzji, gdy cel jest obiektywnie możliwy do osiągnięcia i pożądany.

W odniesieniu do wyzwalacza, błąd poznawczy może jego działanie zarówno wzmocnić, jak osłabić. Oznacza to, że przy odpowiednim natężeniu błędu poznawczego:

- pewne błędy poznawcze mogą uznać za wyzwalacz czynniki, który w innych okolicznościach nie zostałby tak zinterpretowany.

- obiektywnie istniejący silny wyzwalacz okaże się za słaby, chociaż wystarczyłby do podjęcia decyzji, gdyby błąd tego rodzaju i tej siły nie występował;

- obiektywnie istniejący słaby wyzwalacz okaże się wystarczająco silny do podjęcia decyzji, chociaż bez zaistnienia błędu tego rodzaju i tej siły, by do tego nie wystarczył;

Dla przykładu posłużę się tabelą, w której przedstawiam możliwy wpływ poszczególnych błędów poznawczych na wybrane element triady decyzyjnej, jakim jest wykonalność.

Tabela 2: Wpływ wybranych błędów poznawczych na percepcję wykonalności zadania w modelu Fogga

Błąd poznawczy | Jak zniekształca percepcję wykonalności | Konsekwencje dla podjęcia decyzji o zmianie w modelu Fogga |

|---|---|---|

| Błąd konfirmacji (confirmation bias) | Utwierdza w przekonaniu, że wcześniejsze działania były poprawne | Może skutkować decyzją o zmianie / brakiem decyzji o zmianie |

| Podstawowy błąd atrybucji | Tłumaczy postawę drugiej strony jej domniemanymi cechami wewnętrznymi (np. cechami charakteru) | Może skutkować decyzją o zmianie / brakiem decyzji o zmianie |

| Feedback loop (pętla zwrotna) | Wzmacnia pierwotne założenia, prowadzi do radykalizacji. | Może skutkować decyzją o zmianie / brakiem decyzji o zmianie |

| Sprzężony błąd konfirmacji (coupled confirmation bias) | Prowadzi do radykalizacji, i eskalacji | Skutkuje podjęciem decyzji o zmianie |

| Status quo bias | Prowadzi do chęci utrzymania stanu obecnego (status quo) | Skutkuje brakiem decyzji o zmianie |

| Efekt utopionych kosztów (sunk cost fallacy) | Prowadzi do chęci utrzymania stanu obecnego (status quo) i jego pogłębienia | Skutkuje brakiem decyzji o zmianie |

| Hiperużyteczność AI (hyper‑usefulness bias) | Wzmacnia pierwotne założenia, co może prowadzić do radykalizacji. | Może skutkować decyzją o zmianie / brakiem decyzji o zmianie |

Wpływ błędów poznawczych na parametry decyzji

Błąd poznawczy może (niezależnie do wcześniejszego wpływu na samo podjęcie decyzji zgodnie z modelem Fogga), pojawić się i zadziałać na kolejnym etapie, tj. ustalaniu parametrów wykonania decyzji.

Może więc wpłynąć na jej wektor i skutkować tym, że reagując na dany bodziec podejmiemy błędną decyzję o utrzymaniu lub zmianie stanu obecnego. Przykład: radio gra za głośno. Decyduję o usunięciu niezgodności między głośnością muzyki, a moim samopoczuciem. Błąd poznawczy może skutkować tym, że zamiast dostosować radio do siebie: ściszyć je lub wyłączyć (wektor 1, dynamika 1, determinacja L) będę starał się przyzwyczaić (wektor 1, dynamika 0, determinacja L).

Błąd poznawczy może wpłynąć na dynamikę decyzji i skutkować tym, że po ustaleniu wektora decyzji (stosunek do stanu obecnego) wybiorę nieprawidłowo działanie zamiast zaniechania. Przykład: na trekkingu boli mnie noga. Chcę usunąć ból (wektor 1 – zmiana stanu obecnego). Ale pod wpływem błędu poznawczego decyduję błędnie o dynamice i wybieram aktywność (rozchodzić ból) zamiast bierności (zatrzymać się i odpocząć).

Błędy kognitywne tak samo mogą wpłynąć na determinację i zwiększyć ją lub osłabić. Skutkuje to większym zaangażowaniem i skłonnością do ryzyka, niż wynikałoby to z racjonalnej oceny. Przykład: źle prowadzona spółka przynosi straty i wspólnik kolejny raz prosi mnie, żebym dołożył do niej znaczną kwotę. Błąd poznawczy w postaci efektu utopionych kosztów może skutkować zwiększeniem mojej determinacji do zwiększenia inwestycji (wektor 0 – decyzja o pozostaniu, dynamika + w postaci decyzji o dołożeniu pieniędzy), przez co dołożę do niej więcej, niż byłbym gotów, gdybym nie pozostawał pod wpływem tego błędu.

Jak widzimy, błędy poznawcze mogą działać na niezależnie na każdy z elementów składających się na triadę decyzyjną i parametry decyzji.

Działanie błędu kognitywnego i jego możliwe skutki

Proces decyzyjny rozumiem w ten sposób:

1. najpierw jest bodziec;

2. po nim triada decyzyjna skutkuje podjęciem decyzji lub brakiem decyzji;

3. następnie wybierane są parametry decyzji, które mają funkcję wykonania podjętej decyzji.

Zaznaczam, że wybór parametrów decyzji może być prawidłowy lub nieprawidłowy (jak ucieczka na drzewo przed niedźwiedziem). One są jedynie narzędziem, sposobem realizacji decyzji mającej swe źródło w motywacji. Od nas, lub od czynników zewnętrznych zależy, czy prawidłowo przeprowadzimy rozumowanie fundamentalne: wybór sposobu realizacji celu. W praktyce adwokackiej widzę, jak często ludzie popełniają tu rażące błędy: chcą coś osiągnąć, ale korzystają z narzędzi, które nie mogą ich przybliżyć do celu. Albo korzystają z nich nieprawidłowo.

Błędy, jakie możemy popełnić ustalając parametry decyzji możemy podzielić na:

- wybór narzędzia, które w żadnych warunkach nie służy osiągnięciu danego celu;

- wybór narzędzia, które w tych warunkach nie nadaje się osiągnięcia wyznaczonego celu;

- błędne użycie dobrze wybranego narzędzia:

- co do sposobu;

- co do kierunku.

Zwróćmy uwagę, że błędy poznawcze mogą wpływać na ostateczny kształt naszej decyzji na każdym etapie jej podejmowania:

- powstania motywacji;

- oceny wykonalności;

- podatności na wyzwalacz;

- ustawienia parametrów wykonania decyzji.

Jak konkretny błąd poznawczy może zniekształcić decyzje?

Przyjrzyjmy się teraz, jak niektóre błędy poznawcze mogą wpływać na: 1) podjęcie decyzji (triada decyzja Fogga) i 2) jej parametry decyzji: wektor, dynamikę i determinację.

Nie mam tu miejsca na pokazanie wszystkich wariantów: wpływu każdego z rozpoznanych błędów na każdy z elementów triady decyzyjnej i każdy z elementów parametrów decyzji. Nie mam tez miejsca na pokazanie wpływu „zespołów błędów poznawczych” działających równocześnie, ani kolejno.

To, co w ramach artykułu mogę zrobić, to pokazać, jak działa jeden błąd na proces podejmowania decyzji. Posłużę się więc błędem potwierdzenia (confirmation bias).

Jako punkt wyjścia należy oczywiście przyjąć najbardziej prawdopodobną decyzję, jaka byłaby podjęta, gdyby nie wpływ błędu.

Wpływ błędu konfirmacji na poszczególne elementy procesu decyzyjny.

Posłużmy się wyżej opisanym przykładem o spotkanym w górach niedźwiedziu.

Moje sensory biologiczne dostrzegają zagrożenie -> powstaje motywacja do zachowania życia -> oceniam zadanie jako wykonalne -> wyzwalaczem jest ocena, że pojawia się krótkie okienko czasowe, w którym mam szansę, ale działać muszę teraz -> podejmuję decyzję o tym, że chcę pozostać żywy (wektor 0) -> jako narzędzie (tym razem) wybiorę udawanie martwego (bierność, dynamika -) -> moja determinacja jest bardzo wysoka (H).

Ta determinacja jest w tym przykładzie bardzo ciekawa. Przejawi się w mojej tolerancji na koszty – niedźwiedź będzie mnie drapał, sprawdzał, może mnie podeptać, ale ja decyduję się pozostawać w niekomfortowej sytuacji (do której nie przywykłem), w której doznaję kolejnych strat i uszkodzeń, tak długo, jak to będzie potrzebne.

Jak w takiej sytuacji może zadziałać błąd konfirmacji? Przypomnijmy, że polega on na tym, że szukamy potwierdzenia słuszności wcześniej podjętej decyzji i przypisujemy walor potwierdzenia tym czynnikom, które go logicznie nie niosą.

W opisanym przykładzie błąd potwierdzenia może przejawić się np.:

Wpływ tego błędu może przedstawić poniższa tabela.

Tabela3: Wpływ błędu konfirmacji na proces decyzyjny

| Etap procesu decyzyjnego | Element | Wpływ błędu potwierdzenia: wzmocnienie ⬆️ lub osłabienie ⬇️ | Skutek |

|---|---|---|---|

| Triada Fogga | Motywacja | ⬆️ lub ⬇️ | jesteśmy skłonni do utrzymania wcześniej obranego kursu |

| Wykonalność | ⬆️ lub ⬇️ | percepcja wykonalności jest zaburzona. Kierunek zależy od tego, czy analizowane działanie jest zgodne z wcześniej obranym kursem | |

| Wyzwalacz | ⬆️ lub ⬇️ | Możemy być nadreaktywni lub odwrotnie – nie reagować na wyzwalacze, na które byśmy zareagowali, gdyby nie błąd | |

| Parametry decyzji | Wektor (0/1) | ⬆️ | wektor zostaje potwierdzony |

| Dynamika (+/–) | ⬆️ | przyjęta dynamika zostaje wzmocniona | |

| Determinacja (L/H) | ⬆️ | Determinacja rośnie do poziomu nieracjonalnego |

Wpływ różnych błędów poznawczych na wybrany element procesu decyzyjnego

Jak wyżej wspomniałem, każdy z błędów poznawczych może działać na każdy (z osobna, lub wybrane łącznie) element procesu decyzyjnego. Wyżej pokazałem, jak wybrany błąd poznawczy – błąd konfirmacji – działa na cały proces decyzyjny. Teraz pokażę, jak każdy z błędów poznawczych może działać na wybrany element procesu decyzyjnego. Niech będzie nim wektor decyzji. Dla ułatwienia pozostanę przy znanym już przykładzie z niedźwiedziem.

Tabela 4: Wpływ wybranych błędów poznawczych na wektor decyzji (na przykładzie spotkania niedźwiedzia)

| Błąd poznawczy | Jak zniekształca ocenę sytuacji | Wpływ na wektor decyzji (0 = status quo / 1 = zmiana) | Przykład z niedźwiedziem |

|---|---|---|---|

| Błąd potwierdzenia | Wzmacnia wcześniejsze założenia i interpretacje | Może utrwalić wektor 0 lub 1, zależnie od wcześniejszej narracji | Chcąc przeżyć mogę myśleć życzeniowo i dostrzegać szanse tam, gdzie ich nie ma, by podtrzymać nadzieję |

| Podstawowy błąd atrybucji | Przypisuje zachowanie niedźwiedzia jego „złym intencjom” zamiast sytuacji | Może utrwalić wektor 0 lub 1, zależnie od wcześniejszej narracji | Uznaję, że niedźwiedź „na pewno mnie zaatakuje”, choć tylko mnie obserwuje → zaczynam uciekać, czym prowokuję, że zaczyna mnie gonić |

| Status quo bias | Przecenia bezpieczeństwo obecnego stanu | Wypycha w stronę wektora 0 | Zostaję w bezruchu, mimo że niedźwiedź mnie zauważył i sytuacja wymaga zmiany |

| Efekt utopionych kosztów | Wzmacnia przywiązanie do wcześniejszej strategii | Utrwala wektor 0 lub 1 w zależności od sytuacji | „Skoro już tyle wytrzymałem udając martwego, muszę wytrzymać dalej” – mimo że sytuacja się pogarsza, bo niedźwiedź na mnie siedzi i za chwilę się uduszę |

| Sprzężony błąd konfirmacji | Nie wystąpi, gdyż niedźwiedź nie korzysta z AI (póki co) | nie zadziała | nie zadziała |

| Myślenie tunelowe | Zawęża percepcję do jednego aspektu sytuacji | wzmacnia obrany wektor | Wszedłem na drzewo i cieszę się, że uratowałem życie. Wypieram, że niedźwiedzie doskonale chodzą po drzewach i on za chwilę wejdzie. |

| Feedback loop (pętla zwrotna) | Wzmacnia pierwotną interpretację przez kolejne bodźce | Utrwala wektor 1 lub 0, zwykle w kierunku eskalacji | Siedzę na drzewie i dzwonię do kolegi, który mówi mi, że to świetny pomysł. Moje przekonanie o tym ulega wzmocnieniu. Przynajmniej, dopóki niedźwiedź nie zgłodnieje na tyle, żeby się po mnie pofatygować |

| Hiperużyteczność AI (hyper‑usefulness bias) | Przecenia trafność wcześniejszych „podpowiedzi” lub heurystyk | Wektor ustawiany zgodnie z wcześniejszą „podpowiedzią”, nie z realną sytuacją | Jeśli siedząc na drzewie pytam AI, czy dobrze zrobiłem, a mój cyfrowy asystent odpowie: „Andrzeju, to świetna decyzja…” Wówczas będę tak pewny, że mogę zacząć niedźwiedzia nawet prowokować |

Wpływ błędów poznawczych na podejmowanie i parametry decyzji. Podsumowanie

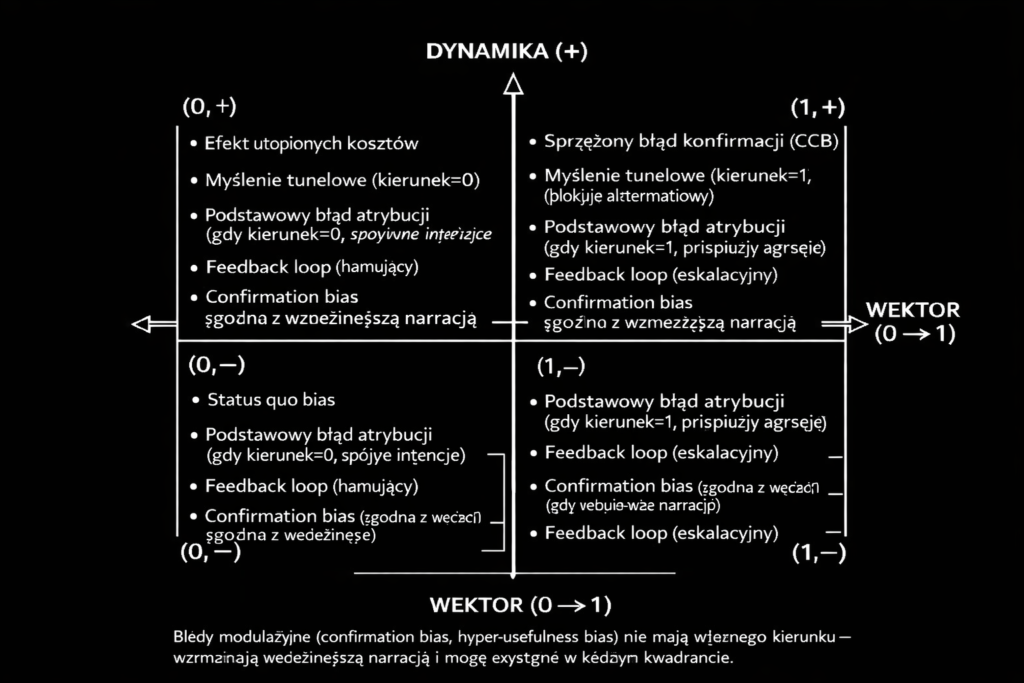

Próba analizy działania poszczególnych błędów poznawczych pozwala na ostrożne wyciągnięcie wniosku, że część z nich ma tendencję do konkretnego wpływania na poszczególne parametry decyzji. Dla przykładu posłużę się dwuwymiarowym wykresem, który obejmuje tylko wektor i dynamikę, ale nie obejmuje determinacji (to wymagałoby wykresu trójwymiarowego). Widzimy na nim, że niektóre błędy częściej będą skutkować „ciągnięciem” danego parametru w danym kierunku, inne zaś nie będą miały wpływu np. na dynamikę, ale będą miały wpływ na wektor. Można to ostrożnie przedstawić w następujący sposób.

Zapamiętajmy z tego jedno. Mylić się jest rzeczą ludzką. Mylimy się wszyscy i ciągle. Na część z przyczyny naszych błędów mamy wpływ, na inne nie mamy. Błędy poznawcze mają tę cechę, że działają skrycie i bardzo mocno wpływają na nasze postrzeganie rzeczywistości, wciągają, jak ruchome piaski i sprawiają, że możemy stracić kontakt z rzeczywistością.

Najłatwiej możemy się przed nimi uchronić poznając je, ucząc się ich i sprawdzać logikę naszego myślenia. Jeśli je poznamy, nauczymy się je wyławypać, a to uchroni nas przed wieloma bardzo kosztownymi błędami.

AI JAKO DORADCA W SPRAWACH RODZINNYCH

W kilu ostatnich wpisach zająłem się rolą AI w rozwiązywaniu i eskalacji sporów między wspólnikami. Teraz chciałem przyjrzeć się temu, jak ludzie wykorzystują sztuczną inteligencję w sprawach bardzo delikatnych. Mam na myśli sprawy rodzinne. Opiszę Wam przypadki, z którymi zetknąłem się osobiście – żeby daleko nie szukać – w grudniu 2025 roku. Są one dla mnie szczególnie interesujące, ponieważ zajmuję się konfliktami jako zjawiskiem i obserwuję rosnącą rolę AI w ich powstawaniu i eskalacji. Sprawy rodzinne są jednym z obszarów, gdzie jest to szczególnie widoczne.

AI w sprawach rodzinnych i jej wpływ na zachowanie ludzi

Coraz częściej dostrzegam silny wpływ AI na dynamikę sporów rodzinnych. W tym tekście podzielę się z Wami sprawami z ostatnich tygodni. Zmieniam oczywiście szczegóły tak, aby uniemożliwić identyfikację kogokolwiek. Z każdą z osób, których historię przedstawiam, rozmawiałem kilka razy osobiście lub online. Opisuję zjawisko nowe, którego konsekwencje dla życia rodzinnego i dobrostanu psychicznego jednostek, rodzin i społeczności nie są jeszcze zbadane. Staram się powstrzymywać od ocen – zostawiam je Wam.

SPRAWA PIERWSZA – PYTANIE O KONTAKTY Z DZIECKIEM PO ROZWODZIE

Zgłosił się do mnie Klient, który właśnie się rozwiódł. Nie uczestniczyłem w tym rozwodzie. Mężczyzna między 30, a 40 – dobrze prosperujący i inteligentny. Prosił o pilną poradę. Ustalił bowiem w trakcie rozwodu, który odbył się 2 tygodnie wcześniej, że będzie miał kontakty z dziećmi w określone dni w tygodniu i co drugi weekend. Co ważne – państwo ciągle ze sobą mieszkają.

W związku z tym, była żona powiedziała mu, że zamierza w najbliższy weekend wyjść na imprezę – a on zgodnie z ustaleniami – ma zająć się dziećmi.

Pan zapytał jeden z modeli AI, czy ustalone kontakty oznaczają, że on musi się w tym czasie zajmować dziećmi, czy też jest to jedynie jego prawo, „zabezpieczenie”, gdyby była żona zamierzała mu to utrudniać. Czat utwierdził go w przekonaniu, że jest to jedynie jego prawo, a więc matka nie ma prawa od niego oczekiwać, że zajmie się dziećmi. Po tej „rozmowie” z AI doszło do gwałtownej kłótni między nimi.

Pomijam już fakt, że takie kwestie powinni klientom wytłumaczyć ich prawnicy. Jest to w końcu abecadło nowej rzeczywistości. Problem polegał na tym, że model językowy nie udzielił prawidłowej porady prawnej. Odpowiedź była nieprawdziwa. Utwierdziła jednak tego pana w mylnym przekonaniu. To, co się stało dalej jest idealnym przykładem sprzężonego błędu atrybucji.

Użytkownik miał wątpliwości. Opisał wycinek rzeczywistości w sposób, który pozwolił czatowi na udzielenie odpowiedzi utwierdzającej go w błędnym przekonaniu. Spowodowało to utwierdzenie, wzmocnienie tego przekonania i gotowość do konfrontacji i eskalacji.

Sprawa druga – AI jako wynajęty psychoanalityk

Klientka koło 30 roku życia. Inteligentna, wykształcona i bardzo dobrze zarabiająca. Przygotowując się do sprawy poprosiła popularny model AI o stworzenie modelu psychologicznego swojego męża.

Opisała go dokładnie tak, jak go widziała. Czat odpowiedział, że „co prawda nie jest psychologiem, ale…” chętnie pomoże. Po czym przypisał mu połowę istniejących zaburzeń utwierdzając ją m.in. w tym, że mąż jest niedojrzały emocjonalnie, głęboko narcystyczny i psychopatyczny.

W oparciu o rozmowę z modelem AI stwierdziła, że nie może mu zaufać i zostawiać z nim dziecka, gdyż nie byłoby to dla tego dziecka bezpieczne.

Gdy zaproponowałem, żeby skonsultowała to z psychologiem, powiedziała, że nie ma takiej potrzeby. Czat odpowiedział jej już na wszystkie pytania. W efekcie ta pani gotowa uniemożliwić mężowi kontakty z synem, by go chronić przed ojcem.

Problem nie polegał na samej analizie. Chodzi o to, że rozmowa z modelem AI została potraktowana jak diagnoza kliniczna, a opierała się wyłącznie na jednostronnym opisie. Pomijam już, że dokonał jej model językowy, a nie uprawniony do tego psychiatra lub psycholog. On również powinien zbadać pacjenta, posłużyć się testami i obserwacją, a nie bazować na samej relacji zaangażowanej osoby.

Nie przyjąłem tej sprawy.

Sprawa trzecia – AI jako analityk rozmów

Przyszli do mnie na mediację rodzice dwojga małych dzieci. Początkowo po rozstaniu ich rodzicielska współpraca przebiegała poprawnie. Od tego czasu państwo rozmawiali ze sobą niemal już wyłącznie przez komunikator WhatsApp i dość długie wiadomości pisane na nim.

Wkrótce zaczęli wzbudzać w sobie nieufność, doszukiwać się ukrytych zamiarów, aluzji i wielowariantowego planowania w celu zaszkodzenia sobie. Oboje nabrali przekonania, że drugie z nich gotowe jest użyć dzieci przedmiotowo, a nawet godziło się na długotrwałe ujemne następstwa psychiczne po ich stronie, byle postawić na swoim.

Okazało się, że każde z nich wklejało otrzymane wiadomości do okna modelu AI, który szczegółowo je analizował, po czym pomagał przygotować odpowiedź. Odpowiedź taka była wysyłana i poddawana podobnej analizie przez drugą stronę.

Powstała spirala podejrzeń i gotowość do podejmowania coraz bardziej radykalnych kroków. Każde z nich straciło w pewien sposób kontakt z rzeczywistością.

AI w sprawach rodzinnych – wnioski

Te trzy przykłady z mojej praktyki pokazują, że mamy tendencję do:

- szukania potwierdzenia pierwotnych założeń;

- podlegamy wzmocnieniu przekonań po otrzymaniu potwierdzenia;

- preferujemy AI jako źródło potwierdzenia, gdyż jest:

- szybsze;

- tańsze;

- milsze;

- stoi za nią nimb wszechwiedzy i tajemniczości, przez co wydaje nam się bardziej atrakcyjna, niż jakiś prawnik albo psycholog.

Prowadzi to do powstania myślenia tunelowego i gotowości do szybkiego i nieprzemyślanego wchodzenia na wyższe szczeble eskalacji w sporze. Co najgorsze, nasze pierwotne uprzedzenia i przekonania ulegają wzmocnieniu, gdyż uznajemy, że dostaliśmy potwierdzenie od niezawodnej technologii.

Skutki tego zachłyśnięcia się AI są obecnie trudne do przewidzenia. I problem nie leży w samej technologii, ale w tym, że wiele osób nie potrafi krytycznie oceniać uzyskiwanych odpowiedzi.

Co ważne, AI sprzyja też potęgowaniu skutków podstawowego błędu atrybucji, o czym pisałem już tutaj:

O tym, że klienci przychodzą do mojej kancelarii z gotowymi „rozwiązaniami” i oczekują ich realizacji pisałem już kilka razy. Motyw AI w sprawach rodzinnych przewija się u mnie od początku 2025 roku. Możecie przeczytać np. ten artykuł:

O myśleniu tunelowym i sprzężonym błędzie konfirmacji pisałem z kolei tu:

Dla zainteresowanych: badania naukowe o roli AI w utrwalaniu błędów poznawczych

AI w sprawach rodzinnych pojawia się coraz częściej i ma coraz większy wpływ na przekonania, wybory i zachowania ludzi. Okazuje się, że moje obserwacje mają silne oparcie w badaniach naukowych. Zobaczcie sami.

Polecam Wam artykuł opublikowany już rok temu: Jak pętle sprzężenia zwrotnego człowiek-AI zmieniają ludzkie osądy percepcyjne, emocjonalne i społeczne (Nature Human Behaviour). Autorzy wykazali, że AI potwierdzające ludzkie założenia prowadzi do wzmocnienia percepcji, emocji i ocen społecznych. Przeczytajcie go koniecznie: https://www.nature.com/articles/s41562-024-02077-2?

Zdecydowanie warto przeczytać również artykuł Yiran Du: Confirmation Bias in Generative AI Chatbots. Zawiera on analizę tychże mechanizmów błędu potwierdzenia w modelach AI. Przeczytamy w nim również o ryzykach związanych z tym sprzężeniem: https://arxiv.org/abs/2504.09343?

Wreszcie tutaj macie link do tekstu o myśleniu tunelowym, które powstaje wskutek mało krytycznego podejścia do odpowiedzi uzyskiwanych od AI: Bias in the Loop: How Humans Evaluate AI‑Generated Suggestions. Autorzy twierdzą, że eksperymenty dowodzą, że użytkownicy przyjmują błędne sugestie AI, jeśli pasują do ich wcześniejszych przekonań: https://arxiv.org/pdf/2509.08514

Tutaj zostawiam linki do analizy naukowców z Uniwersytetu Stanforda, którzy zajęli się zjawiskiem „halucynowania” AI i jego wpływem na podejmowanie decyzji przez ludzi: https://hai.stanford.edu/news/ai-trial-legal-models-hallucinate-1-out-6-or-more-benchmarking-queries?utm_source=chatgpt.com

Zapraszam Was do kontaktu

Jeśli potrzebujecie pomocy prawnika, który zajmuje się rozwiązywaniem sporów – również w zakresie spraw rodzinnych – odezwijcie się do mnie:

📩 kancelaria@jakubieciwspolnicy.pl

📞 536 270 935

Z przyjemnością Wam pomogę!

AI I MYŚLENIE TUNELOWE W SPORACH MIĘDZY WSPÓLNIKAMI

Sprzężony Błąd Konfirmacji (Coupled Confirmation Bias) w pracy z modelami AI coraz częściej daje o sobie znać w sporach gospodarczych. Widzę to nawet w mojej własnej praktyce. Zdarza się, że klienci przychodzą do mnie z gotowym planem działania. Wcześniej skonsultowali sytuację swojej spółki z modelem językowym. Oczekują, że po prostu zrealizuję ten plan. Rozmowy z nimi bywają trudne. Staram się zrozumieć, jak doszli do tych wniosków, jakie zadawali pytania, jakie przyjęli założenia. Tłumaczę nieścisłości w tym rozumowaniu i próbuje ustalić wszystko od początku. Dlaczego? Bo odczuwam silną potrzebę rzetelnego wykonania swojej pracy i zbadania sprawy. Część klientów to rozumie. Inni uważają to za zbędne, ponieważ sprawa została już przecież „przeanalizowana” (w założeniu – przez „kogoś” mądrzejszego ode mnie). Kilku z nich zarzuciło mi wręcz chęć dublowania pracy w celu zawyżenia kosztów. Twierdzą, że AI wykonała już pracę i zaproponowała rozwiązanie.

Jakiś czas temu zacząłem się zastanawiać, czemu tak się dzieje. Poczytałem więcej o znanym w psychologii błędzie konfirmacji i nowo opisanej tendencji modeli językowych do „przytakiwania”. Okazuje się, że dyskusja z AI może prowadzić do błędu konfirmacji, który zostanie wzmocniony „życzliwością” i „uprzejmością” modeli AI. Tak doszedłem do wniosku, że połączenie tych dwóch zjawisk można nazwać Sprzężonym Błędem konfirmacji. Jest to moja robocza nazwa. Jednak to, co obserwuje w mojej praktyce adwokackiej nie dawało się jeszcze wyjaśnić tylko przez Sprzężony Błąd Konfirmacji.

Błąd ten wpływa na postawy niektórych klientów. Część z nich udaje mi się przekonać. Inni są zaskoczeni, gdy odmawiam współpracy. Niektórzy reagują nawet oburzeniem. Jedna osoba oskarżyła mnie — jeszcze przed jakąkolwiek merytoryczną rozmową — że nie znam się na spółkach ani negocjacjach.

O tym, jak czynniki indywidualne mogą wpływać na podatność poddania się Sprzężonemu Błędowi Konfirmacji, możecie przeczytać m.in. tutaj:

Ben Wang i Jiqun Liu Cognitively Biased Users Interacting with Algorithmically Biased Results in Whole-Session Search on Debated Topics, https://dl.acm.org/doi/10.1145/3664190.3672520

W tym kontekście tragikomiczne wydaje się, że moja rzekoma „ignorancja” miała wynikać z chęci przeczytania umowy spółki. Chciałem także omówić historię współpracy wspólników. Witajcie w erze AI!

W tym artykule napisałem nieco więcej o Sprzężonym Błędzie Konfirmacji w sporach między wspólnikami

Możecie go najpierw przeczytać, ale jeśli nie macie ochoty – nie ma sprawy. Ten artykuł można traktować jako zamkniętą całość.

Spory między wspólnikami: Dlaczego chcemy potwierdzać nasze przekonania?

O samych przyczynach sporów między wspólnikami opowiadałem m.in. w moim podcaście:

Na mojej stronie znajdziecie jednak szereg publikacji, które ten temat rozwijają.

Spory między wspólnikami. Dlaczego poszukujemy potwierdzenia?

W psychologii dobrze znany jest błąd konfirmacji (confirmation bias). Polega on na tym, że ignorujemy informacje sprzeczne z naszymi przekonaniami, a nadmiernie doceniamy te, które je potwierdzają.

Przykład: Jeśli wierzymy, że Ziemia jest płaska, to będziemy tak interpretować dostępne dane, żeby tę tezę potwierdzić. Niewygodne fakty pominiemy, inne będziemy lekko naciągać.

Błąd konfirmacji nie jest zarzutem, który kieruję do kogokolwiek. Jest on doskonale zbadanym w psychologii zjawiskiem. Dobrze, gdy jesteśmy go świadomi.

Psychologicznie jest to mechanizm obronny. Jego celem jest utrzymanie spójności poznawczej i redukcja napięcia emocjonalnego. W końcu intelektualny niepokój nie służy większości z nas. Chcemy więc go wyeliminować.

W sporach każda strona przedstawia więc wersję „korzystną dla siebie”. Selekcjonuje fakty, czyni wygodne dla siebie założenia, które przewija w narracji z faktami. Interpretuje je korzystnie dla siebie. Jest tak na wielu płaszczyznach sporów: od kłótni między przedszkolakami, przez spory małżeńskie, biznesowe i międzynarodowe. W sporach między wspólnikami mechanizm błędu konfirmacji ujawnia się również z całą mocą.

Do tej pory często zdarzało mi się, że klienci przychodzili do mnie z gotową „diagnozą” i „planem leczenia”. Szukali prawnika, który przyjmie to za pewnik i wykona. Chcecie wiedzieć, dlaczego nigdy się na to nie godzę? Przeczytajcie mój tekst:

Sprzężony Błąd Konfirmacji w pracy z AI

Czym jest Coupled Confirmation Bias – Sprzężony Błąd Konfirmacji (Potwierdzenia)?

Coupled Confirmation Bias to mechanizm, w którym nasze pierwotne przekonania są wzmacniane przez interakcję z AI. Schemat wygląda następująco:

- Użytkownik formułuje tezę (np. przekonanie o nieuczciwości wspólnika).

- Model AI generuje odpowiedź zgodną z tym założeniem (hiperdopasowanie), o ile brak jest wyraźnych błędów wewnętrznych lub sprzeczności z wiedzą powszechnie dostępną. Model językowy nie zna całej historii współpracy, nie zna faktów innych, niż podane, nie czyni rozróżnień między faktem, założeniem, domysłem, interpretacją. Chce być „użyteczny” i czasem wprost, czasem częściowo, ale najczęściej potwierdza tezę użytkownika.

- Użytkownik traktuje AI jako autorytet, w czym jest mocno utwierdzony po uzyskaniu potwierdzenia swojej tezy.

- Powstaje sprzężenie zwrotne prowadzi, które do jeszcze silniejszego przekonania i pogłębienia tunelu poznawczego.

- Nowe siły: AI wzmacnia nasze przekonania → użytkownik działa na ich podstawie, ale „uwznioślony” i”wzmocniony” uzyskanym potwierdzeniem i gotów jest do bardziej zdecydowanego działania → konflikt eskaluje.

- Standardowa formułka modeli AI, że nie są prawnikami i żeby użytkownik skonsultował się z prawnikiem ma ten skutek, że wielu użytkowników będzie szukało prawników, którzy potwierdzą wnioski modeli AI traktując to jako główne kryterium oceny kompetencji prawnika! Będą szukać, aż znajdą.

W praktyce oznacza to, że AI działa jak „lupa”, która wzmacnia nasze postawy wyjściowe, niezależnie od ich prawdziwości. A my usuwamy z pola widzenia wszystko, co przeczy pierwotnej tezie. O hiperdopasowaniu możecie przeczytać tu: Christoph M. Abels i in.: The governance & behavioral challenges of generative artificial intelligence’s hypercustomization capabilities, https://journals.sagepub.com/doi/10.1177/23794607251347020

Dlaczego AI naturalnie potwierdza nasze przekonania?

Modele językowe nie „myślą” samodzielnie. Ich odpowiedzi wynikają z statystycznej predykcji kolejnych słów na podstawie kontekstu promptu. Co więcej, są one najczęściej wewnętrznie spójne. Moim zdaniem na rzeczy jest znacznie więcej, niż predykcja w tym wąskim rozumieniu, ale czy to jest myślenie?

Jeśli pytanie zadane modelowi AI sugeruje określoną interpretację, model tworzy spójną narrację. Użytkownik może ją interpretować jako obiektywne potwierdzenie własnej opinii. Warto zaznaczyć, że odpowiedzi generowane przez AI są najczęściej wewnętrznie spójne. Nie zawsze są natomiast spójne zewnętrznie, osadzone w konkretnych realiach, ani poparte znajomością prawa (nie mylić z przepisami).

Wyglądają na pierwszy rzut oka jak wypowiedzi eksperckie i trzeba często rzeczywiście być fachowcem, by zobaczyć istotne nieścisłości, błędy lub przeoczenia, które przekreślają sugerowany kierunek.

Sprzężony Błąd Konfirmacji, Mechanizm Feedback Loop i Dylemat Bezpieczeństwa

Zastanówmy się, co dzieje się, gdy druga strona opisuje swoją subiektywną perspektywę własnemu modelowi AI. Czat potwierdza jej punkt widzenia i go wzmacnia. Wpływ na działania użytkownika jest znaczący. Drugi wspólnik obserwuje to z narastającą podejrzliwością. Jak zareaguje? Jego reakcją będzie prawdopodobnie przygotowanie się walki, która może mieć dla niego charakter ściśle defensywny albo… wybierze atak prewencyjny. Chce jednak upewnić się, że jego interpretacja jest prawidłowa. Co zrobi? Zwróci się do własnego chata, subiektywnie opisując to, co postrzega. Zgadnijcie, jaką odpowiedź otrzyma? Tak…

Sytuacja może wymknąć się spod kontroli. Przypomina partię szachów pomiędzy dwoma oszustami korzystającymi z komputerów. To nie jest już normalna gra. Tylko w tym przypadku, to nie szachy, ale prawdziwe życie.

Każdy wspólnik subiektywnie interpretuje zachowanie „przeciwnika”. Te subiektywnie dobrane i opisane cząstki rzeczywistości przekazuje AI. Model AI potwierdza „nikczemność” drugiej strony i sugeruje radykalne rozwiązania.

Gdy klienci trafiają do mnie, będąc już w tej spirali, racjonalne argumenty często do nich nie docierają.

Mamy tu do czynienia z wyraźnym przykładem Sprzężonego Błędu Konfirmacji po obu stronach, które prowokuje pętlę sprzężenia zwrotnego i myślenie tunelowe (Feedback Loop)! To tzw. dylemat bezpieczeństwa na sterydach. Na czym polega dylemat bezpieczeństwa? To znane w polityce określenie na paradoks sytuacji, w której jedno państwo chcąc uniknąć wojny i potencjalnej agresji zbroi się, a drugie odczytuje to jako przygotowanie do wojny, na które reaguje własnymi zbrojeniami i przygotowaniami. Paradoks bezpieczeństwa może sprowokować konflikt, któremu miał zapobiec.

To samo widzę w postawie niektórych ludzi, którzy prowadzą biznes i konsultują swoje relacje ze wspólnikiem z modelami AI. Do niektórych z nich nie docierają już racjonalne argumenty. A przecież AI dopiero niedawno powstała i dynamicznie się rozwija.

O tym, jak może wyglądać eskalacja sporu między wspólnikami, pisałem ostatnio tutaj:

Warto przeczytać powyższy tekst i nanieść na niego niebezpieczeństwa poznawcze, o których piszę tutaj. To da Wam pełny obraz.

Błąd konfirmacji człowiek – AI wbadaniach naukowych

Obserwacje, które poczyniłem w ostatnim roku, kiedy coraz więcej klientów analizuje swoje sprawy z AI, zostały potwierdzone w badaniach naukowych. Badania te pokazują, że interakcje człowiek–AI mogą wzmacniać uprzedzenia i błędne przekonania.

W 2024 roku opublikowano artykuł Jak pętle sprzężenia zwrotnego człowiek-AI zmieniają ludzkie osądy percepcyjne, emocjonalne i społeczne (Nature Human Behaviour). Autorzy wykazali, że AI potwierdzające ludzkie założenia prowadzi do wzmocnienia percepcji, emocji i ocen społecznych. Przeczytajcie go koniecznie: https://www.nature.com/articles/s41562-024-02077-2?

Polecam Wam również tekst autorstwa Yiran Du: Confirmation Bias in Generative AI Chatbots. Zawiera on analizę tychże mechanizmów błędu potwierdzenia w modelach AI. Przeczytamy w nim również o ryzykach związanych z tym sprzężeniem: https://arxiv.org/abs/2504.09343?

Ostatnim z artykułów, które Wam polecę jest niosący nieco optymizmu Bias in the Loop: How Humans Evaluate AI‑Generated Suggestions. Autorzy twierdzą, że eksperymenty dowodzą, że użytkownicy przyjmują błędne sugestie AI, jeśli pasują do ich wcześniejszych przekonań. Jednakże „wyniki pokazują, że skuteczna współpraca człowieka z AI zależy nie tylko od wydajności algorytmu, ale także od tego, kto ocenia wyniki AI i jak zorganizowane są procesy przeglądu.” Wszystko więc w naszych rękach, ale będzie coraz trudniej. Artykuł znajdziecie tutaj: https://arxiv.org/pdf/2509.08514

Istnienie opisanego mechanizmu jest więc znane w nauce i stanowi przedmiot pracy wybitych naukowców. Jest to awangarda badań nad AI. Trudno też o bardziej wyraźny przykład skutków działania AI na konkretny obszar życia – w tym wypadku relacji negocjacyjnych w sporach między wspólnikami. Jak to może wyglądać?

Podsumowanie

Coupled Confirmation Bias pokazuje, że AI nie jest neutralnym arbitrem, ani najmądrzejszym doradcą. Nasze subiektywne przekonania i uprzedzenia mogą się wzmacniać w sprzężeniu zwrotnym. W sporach między wspólnikami może to prowadzić do błędnych decyzji, eskalacji konfliktu i tuneli poznawczych. Nigdy rolą prawnika nie było potwierdzanie wyobrażeń klienta. Dzisiaj jednak trzeba pójść krok dalej i czasem pomóc niektórym odzyskać kontakt z rzeczywistością.

Wszystko jednak zależy od nas samych. Sztuczna inteligencja daje ogromne możliwości. Możemy przecież wydać dyspozycję naszemu „rozmówcy”, by był krytyczny wobec naszych pomysłów. Może wcielić się na nasze polecenie w rolę adwokata diabła i przedstawiać kontrargumenty, szukać luk w naszym rozumowaniu albo pomóc znaleźć inne wytłumaczenia zdarzeń, niż to, które my przyjęliśmy za pewnik. AI doskonale sprawdza się w eliminacji skutków podstawowego błędu atrybucji, który ma tak ogromne znaczenie w sporach biznesowych albo rodzinnym. Pisałem o tym tutaj:

Gdy przychodzi do mnie Klient z gotową oceną sprawy albo radami udzielonymi przez AI, nie obrażam się. Rozmawiam z nim. Niemal zawsze się z nimi zapoznaję. Jedno z kilku rozwiązań może być ciekawe. Mogę znaleźć tam rozwiązanie, które nie przyszłoby mi do głowy.

Najczęściej udaje mi się zyskać zaufanie Klientów, którym tłumaczę, jak działają modele językowe (tak, jak sam to rozumiem) oraz pokazuję rozwiązania, które mogę zawsze obronić.

Zdarza się, że Klient notuje, co mówię. A potem wraca do mnie za kilka dni i mówi, że już mi zaufa, bo powtórzył moje argumenty AI, a ta – przyznała mi rację. Jest to sukces słodko – gorzki w świetle tego, co wyżej pisałem.

Jeśli potrzebujecie pomocy prawnika, który zajmuje się negocjacjami i sporami miedzy wspólnikami, możecie się do mnie odezwać:

📩 kancelaria@jakubieciwspolnicy.pl

📞 536 270 935

Z przyjemnością Wam pomogę!